「ONSEI」はどのような仕組みで認知機能を判断しているのでしょうか?

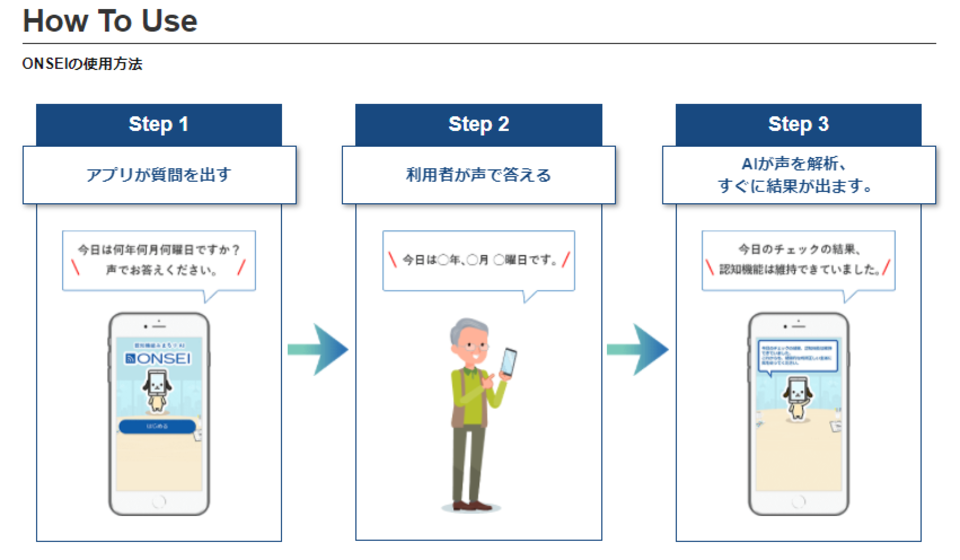

増岡:スマートフォンにダウンロードした「ONSEI」アプリを立ち上げ、画面に向かって今日の日付「西暦何年の何月何日何曜日」を声で入力します。それにより、認知機能を計測します。声を活用しようと決めるまでには、何が最も適した生体情報なのかと、表情や目の動きなど、いくつもの要素で研究を重ねました。

声を活用する決め手は何だったのでしょう。

増岡:並行して多くの生体情報で研究しましたが、精度が不安定だったり、判別するまでに時間が掛かったり、社会実装上、非現実的だったりする中で、判別精度、時間、社会実装面で、「声」が最も適していると判断しました。具体的には、基本的な状況把握となる、今日の日付の正誤の判定にプラスして、周波数をはじめとする「音声特徴量」や声から判別できる「言語・思考・認知・記憶・行為・注意」などの要素などの要素をAIが分析して、認知機能低下の疑いの有無を判別しています。そのため、間違った日付を答えたというだけで、認知機能の低下を検知するものではありません。ちなみに、AIのベースになるビックデータには、複数の熟練の専門医による、統一した厳格な基準で診断された認知症の方とそうではない方の音声特徴を利用しています。

「ONSEI」のアプリを立ち上げるとこのような画面が現れ、声でその日の「西暦、日付、曜日」を入力し、「回答しました」のボタンを押すという仕組み

もし認知機能に異常があれば、このような画面が現れる。結果は記録されるので、認知機能のモニタリングにも役立つ